L’intelligenza artificiale è entrata nella vita delle aziende e delle persone in modo rapido e, in alcuni casi, dirompente. In pochi anni, strumenti basati su AI generativa, analisi predittiva e automazione intelligente sono passati da prototipi sperimentali a soluzioni operative diffuse, all’interno e all’esterno delle imprese.

Eppure, nonostante il potenziale evidente e un cauto aumento della fiducia e dell’interesse nei confronti dell’intelligenza artificiale, molte organizzazioni si trovano ancora fare i conti con un ostacolo silenzioso ma potente: la resistenza all’AI da parte di alcune persone.

Accogliere l’intelligenza artificiale significa cambiare il proprio modo di lavorare, di prendere decisioni, di interagire con colleghi e strumenti. Significa accettare che alcuni task possano essere automatizzati, che nuove competenze diventino necessarie, che il ruolo individuale si modifichi. E questo, comprensibilmente, genera ansia.

L’obiettivo di questo articolo è, partendo dai dati più recenti sulla fiducia delle persone nell’AI, esplorare le radici di questa resistenza, comprenderne le dinamiche psicologiche e organizzative, e soprattutto indicare strategie concrete per trasformare la paura in opportunità, l’insicurezza in crescita, la resistenza in empowerment.

Aumenta l’ottimismo nei confronti dei prodotti e servizi di AI

Uno degli insight più interessanti dell’ultimo Artificial intelligence Index report dell’Università di Stanford riguarda il cauto aumento dell’ottimismo delle persone riguardo ai prodotti e servizi di intelligenza artificiale.

L’edizione 2025 del report, una delle fotografie più complete sullo stato dell’arte dell’AI, spiega che, a livello globale, la quota di individui che vedono i prodotti e servizi di AI più come vantaggiosi che dannosi è salita dal 52% nel 2022 al 55% nel 2024.

Tuttavia, come ricordano Yolanda Gil e Raymond Perrault, co-direttori del rapporto, “la fiducia rimane una sfida importante” per l’AI e restano aperte le questioni legate all’impatto ambientale, alla disinformazione, all’equità di queste tecnologie e ai pregiudizi (bias) con cui viene alimentata.

Di “cauto ottimismo”, non solo verso le nuove tecnologie ma verso l’andamento del 2025 in generale, parla anche l’istituto di ricerche Ipsos nel suo Ipsos Predictions Survey 2025, in cui viene analizzata nello specifico una delle principali paure legate all’AI: il timore che possa rubare il lavoro a molte persone.

Globalmente, sottolinea Ipsos, questo timore continua a superare le aspettative di creazione di posti di lavoro grazie all’AI, con una percentuale di 65% a 43%.

In Italia, la percentuale di chi teme che l’AI possa causare la perdita di posti di lavoro è uguale, 65%, mentre è più bassa la percentuale di chi è convinto che l’AI creerà nuovi posti di lavoro: 30%. Ipsos conclude che questa tendenza riflette gli anni precedenti, anche se il divario tra timorosi e fiduciosi sembra leggermente ridursi.

Le origini della resistenza: paura, disorientamento e mancanza di controllo

Dai dati presentati nel precedente paragrafo è evidente come, a fronte di un cauto aumento di fiducia e di ottimismo nei confronti degli impatti dell’AI, permangano resistenze e preoccupazioni. Perché?

Ogni trasformazione profonda genera inevitabilmente qualche forma di resistenza. Nel caso dell’AI, questa reazione è particolarmente intensa perché tocca dimensioni identitarie e professionali molto profonde. Non si tratta semplicemente di “imparare a usare un nuovo strumento”, ma di confrontarsi con una tecnologia che promette di fare alcune cose meglio di noi.

La prima forma di resistenza è legata, come già evidenziato, alla paura di perdere il lavoro. Molti professionisti temono che l’intelligenza artificiale renda superfluo il proprio ruolo, innescando una spirale di sostituzione più che di collaborazione. Anche quando l’azienda afferma di voler usare l’AI per affiancare le persone, il timore sottotraccia può restare vivo e condizionare l’approccio.

In realtà, come spiega anche il Future of Jobs report 2025 del World economic forum, l’impatto dell’AI sarà probabilmente più trasformativo che sostitutivo: la maggior parte dei posti di lavoro non saranno né eliminati, né creati ex novo dall’AI, bensì trasformati da queste tecnologie.

La seconda forma di resistenza è di tipo cognitivo: il disorientamento. Di fronte a una tecnologia che evolve così rapidamente, è facile sentirsi impreparati, inadeguati, esclusi. I concetti tecnici possono sembrare troppo complessi, le interfacce troppo diverse, il linguaggio troppo distante. In questi casi, la resistenza nasce da una sensazione di distanza e incomprensione.

Infine, c’è una resistenza legata al senso di controllo. L’AI, per sua natura, suggerisce, automatizza, prende iniziative. Questo può far sentire le persone meno protagoniste, meno rilevanti, meno libere di esercitare il proprio giudizio. Anche quando la tecnologia è utile, se non è chiaro come funziona, può suscitare diffidenza o rigetto.

La resistenza come sintomo e come risorsa

È importante non demonizzare la resistenza. Spesso viene vista come un ostacolo da eliminare il più rapidamente possibile. In realtà, può essere un indicatore prezioso. Rivela dove l’organizzazione ha bisogno di rafforzarsi, dove manca comunicazione, dove le persone sentono di non avere gli strumenti per affrontare il cambiamento.

Trattare la resistenza con superficialità, ad esempio imponendo l’adozione dell’AI dall’alto o relegando la formazione a una questione tecnica, significa perdere un’occasione. Invece di essere solo un ostacolo, la resistenza può diventare un punto di partenza. Può aiutare a costruire percorsi di adozione più umani, più sostenibili, più efficaci.

Riconoscere la resistenza, ascoltarla, interpretarla, è il primo passo per trasformarla. Solo così si può accompagnare davvero il cambiamento e passare da una logica di compliance a una logica di coinvolgimento.

Strategia e cultura: creare un contesto sicuro per l’adozione

Superare la resistenza all’AI richiede molto più di una campagna informativa o di qualche ora di formazione. Serve costruire un contesto psicologicamente sicuro, in cui le persone si sentano autorizzate a fare domande, a esprimere dubbi, a sperimentare senza il timore di sbagliare.

Questo tipo di cultura non si improvvisa. Si costruisce giorno per giorno, attraverso la coerenza dei messaggi, l’esempio della leadership, la qualità delle conversazioni. Se i manager per primi dimostrano apertura verso la tecnologia, se ammettono le proprie incertezze e coinvolgono i team nella sperimentazione, il clima cambia. L’AI non viene più vissuta come una minaccia imposta, ma come un’opportunità da esplorare insieme.

Inoltre, è importante che l’intelligenza artificiale venga sempre contestualizzata. Non va presentata come una panacea o come un’entità astratta, ma calata nella realtà operativa delle persone. Deve essere chiaro cosa risolve, come si integra nel lavoro quotidiano, quali benefici concreti porta, quali limiti ha. Capire ciò che può fare e cosa non può fare, o è meglio che non faccia, come spiega anche un articolo dell’esperto di AI e professore della Wharton University Ethan Mollick.

Formazione come leva di fiducia, non solo di competenza

Uno degli errori più comuni nell’affrontare la resistenza all’AI è considerare la formazione come un atto meramente informativo. In realtà, apprendere qualcosa di nuovo – soprattutto se percepito come potenzialmente minaccioso – è prima di tutto un processo emotivo.

Le persone devono sentire che possono imparare, che è normale non capire tutto subito, che nessuno si aspetta da loro una competenza tecnica completa. Serve un approccio alla formazione che sia progressivo, modulare, pratico, ma soprattutto inclusivo. Deve valorizzare il punto di partenza di ciascuno, riconoscere le difficoltà, accompagnare con esempi concreti.

Formare all’AI significa anche allenare la capacità di interagire con sistemi intelligenti, di giudicare criticamente i risultati, di chiedere l’intervento umano quando necessario. È un’educazione all’uso consapevole e responsabile, più che all’uso tecnico. E questo tipo di educazione genera fiducia, non solo abilità.

Coinvolgimento attivo e protagonismo diffuso

La resistenza diminuisce quando le persone sentono di poter partecipare al cambiamento in modo efficace e sostenibile nel tempo, ossia quando si attivano efficaci percorsi di adoption. Coinvolgere attivamente i team nella sperimentazione dell’AI è una delle leve più potenti per trasformare la percezione del nuovo. Non si tratta di essere “early adopter” per forza, ma di avere uno spazio in cui provare, proporre, criticare, migliorare.

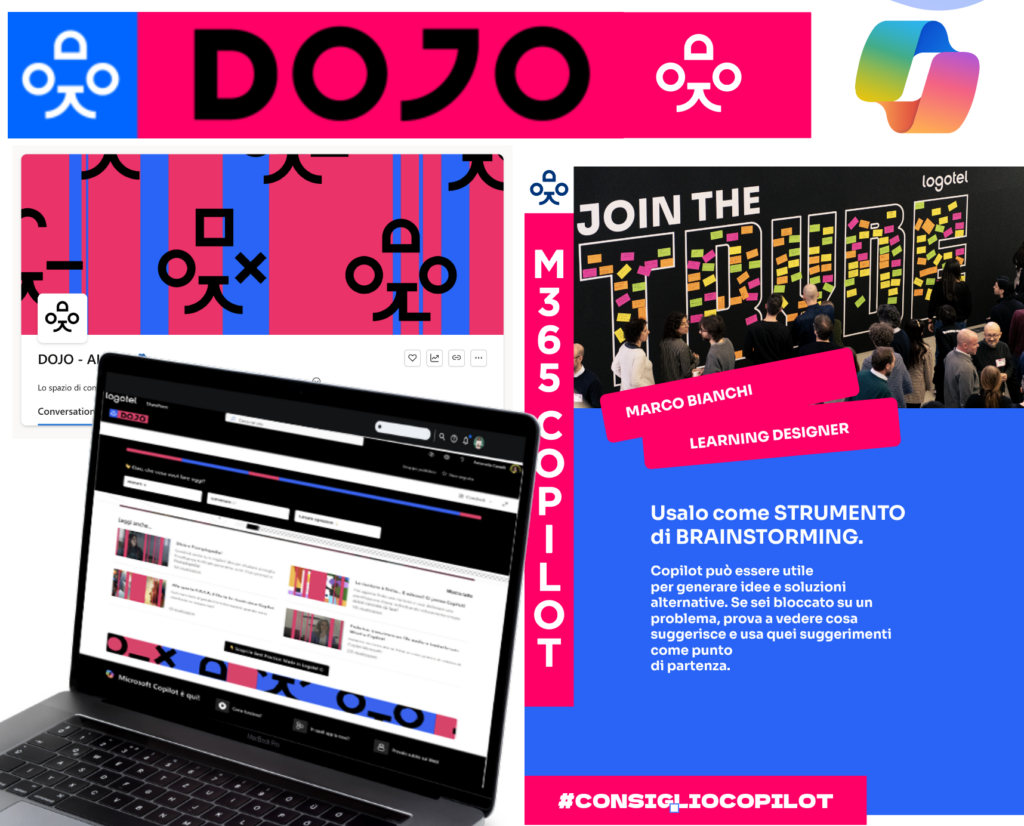

Le community interne possono giocare un ruolo fondamentale in questo processo. Possono diventare luoghi in cui scambiarsi esperienze e best practice, discutere prompt, raccontare successi o piccoli fallimenti. Un esempio concreto è il Dojo, community di adoption dell’AI, nello specifico di Microsoft Copilot, progettata e sviluppata dalla Independent design company Logotel per i suoi clienti.

All’interno di queste community più che esperti, servono facilitatori capaci di creare uno spazio di confronto e di apprendimento reciproco. In questo contesto, il ruolo dei manager è quello di facilitare. Di riconoscere gli sforzi, dare visibilità ai casi d’uso, stimolare la curiosità. Quando l’adozione dell’AI diventa una storia collettiva, in cui ogni persona ha un ruolo e un apporto possibile, l’empowerment si attiva spontaneamente.

Dalla resistenza all’empowerment: un passaggio culturale

Superare la resistenza all’AI non significa solo “convincere” le persone ad accettare la tecnologia. Significa accompagnarle in un percorso di riappropriazione del proprio ruolo nel nuovo contesto. L’obiettivo non è adattarsi passivamente, ma trovare nuovi modi per esprimere le proprie competenze, la propria creatività, il proprio valore.

Quando le persone capiscono che l’AI può liberarli da attività ripetitive, che può amplificare il loro impatto, che può aiutarli a fare meglio ciò che amano, nasce una motivazione autentica. L’empowerment non è il risultato di un cambiamento imposto, ma il frutto di una trasformazione condivisa.

Questo richiede tempo, ascolto, fiducia. Ma soprattutto richiede una visione: l’intelligenza artificiale non come sostituto, ma come estensione: un plus che amplifica le capacità di persone e comunità. L’AI non è un fine, ma un mezzo. Non è una minaccia, ma un’occasione per evolvere insieme.

Conclusioni

Ogni grande innovazione porta con sé resistenze. È fisiologico. Ma è nel modo in cui si affrontano queste resistenze che si gioca il successo della trasformazione. L’intelligenza artificiale, per diventare davvero parte della cultura aziendale, ha bisogno di essere compresa, contestualizzata, umanizzata.

Non serve forzare. Serve costruire. Un contesto di fiducia, una narrazione credibile, una leadership coerente, una formazione accessibile, una partecipazione diffusa. Quando questi elementi si combinano, la resistenza si trasforma in energia. E l’ansia iniziale lascia spazio alla voglia di esplorare.

Perché alla fine, superare la resistenza all’AI non è un problema tecnico, ma una sfida profondamente umana. E come tutte le sfide umane, si affronta con empatia, pazienza, ascolto e visione condivisa.